8月20日,理想汽車6.1.0版本更新,并內測了E2E(端到端)-VLM Beta 2.1版本。

據悉,本次更新增加了端到端-VLM系統(tǒng)與NOA系統(tǒng)切換的功能,可感受不同系統(tǒng)的駕駛風格,系統(tǒng)相互切換時間約為20s。此外,本次更新還迭代了端到端模型,優(yōu)化了跟隨慢速騎行人不繞行、對鄰車道大車點剎等問題,降低系統(tǒng)延遲,提升了系統(tǒng)穩(wěn)定性。

新能源汽車發(fā)展至今,智駕已經成為了“靈魂”,成為了車企們的“兵家必爭之地”。

不可否認,相比2020年前,如今的智駕技術相當亮眼,但也需要承認,近一兩年智駕技術的發(fā)展速度有所減弱,甚至談得上“緩慢”二字。究其原因,核心還是在于技術路線。

目前大多車企智駕技術架構,還是沿用更“靠譜”的模塊化。然而這種不會“犯錯”的技術路線,也意味著編寫大量的代碼、不斷高企的任務量、信息傳遞減損......極大的限制了智駕的潛力和發(fā)展。

忽如一夜春風來。在經過數年緩慢前行之后,隨著AI大模型的快速發(fā)展,端到端技術路線的落地,讓智駕迎來了新的可能。步入2024年之后,端到端技術成為頭部廠商的新風潮。眼下,包括特斯拉、華為、蔚小理在內,不少玩家都在加速迭代端到端智駕技術。

雖然各家在更進一步的技術層面呈現出不同路徑,但這樣的集體推動,卻讓人類智駕技術逼近了質變“臨界點”。

什么是“端到端”?

一直以來,關于實現完全自動駕駛,業(yè)內有兩種不同的聲音,一種是模塊化,一種則是端到端。

就目前而言,主流的智能駕駛系統(tǒng)普遍應用了模塊化,即將自動駕駛任務分解為感知、預測和規(guī)劃三個獨立的模塊,隨后通過系統(tǒng)集成來實現自動駕駛功能。

模塊化技術架構,能夠將復雜的自動駕駛任務簡化為多個相對容易處理的子任務,有效降低了系統(tǒng)開發(fā)的復雜性。由此構建的系統(tǒng)具備較高的可解釋性,允許對每個模塊的輸入和輸出進行詳細的分析,一旦發(fā)生故障,可以快速定位到問題所在。

雖然優(yōu)勢明顯,但這種方法也存在不少缺憾。

首當其沖的是,模塊化技術架構需要編寫大量的代碼,并且在系統(tǒng)設計過程中過度依賴人為的先驗知識。而這無疑限制了自動駕駛系統(tǒng)的潛力,導致其泛化能力不足,面對未知場景時往往難以有效應對。尤其是在國內復雜的道路環(huán)境下,局限性較大。

此前何小鵬在接受《每日經濟新聞》采訪時表示:“模塊化智駕方案從技術上說,汽車在感知、定位、規(guī)劃、控制方面都是分開處理的,每一個環(huán)節(jié)并沒有關聯(lián)。因此車輛在遇到一些場景的時候會因為人類寫入的規(guī)則互相博弈而產生猶豫。”

與模塊化技術架構有很大不同,“端到端”指的是一個AI模型,只要輸入原始數據就可以輸出最終結果。

將端到端應用到智能駕駛領域,意味著只需要一個AI模型,就能把攝像頭、毫米波雷達、激光雷達等傳感器收集到的感知信息,轉換成車輛方向盤的轉動角度、加速踏板的踩踏深度以及制動的力度等具體操作指令,讓汽車實現自動行駛。

對比之下,模塊化自動駕駛系統(tǒng)要一步步來,先識別路標,再預測其他車輛的動向,最后才決定怎么開。而端到端技術卻能一氣呵成,把感知到的一切都直接轉化為行動。

并且,由于大模型會將過去的路跑經驗吸收保留,還會使用過去的數據反復思考某場景下怎么行駛最好,因此在大量的數據積累下,端到端應對各種場景將會越來越靈活。

換言之,端到端無需程序員編寫冗長的代碼去制定規(guī)則,也不會出現信息傳遞減損,解決了模塊化模型存在的核心“痛點”。

頗具優(yōu)勢,但挑戰(zhàn)也多

借助大模型技術的深入應用,端到端自動駕駛系統(tǒng)的優(yōu)勢日益明顯,為自動駕駛技術的進一步發(fā)展提供了一條高效率途徑。

然而,對于押注這一技術路線的玩家們來說,仍然要面臨不少挑戰(zhàn)。其中,擺在玩家們眼前的第一道難關,就是數據。

大模型需要大數據,本質上來講,端到端自動駕駛是海量駕駛視頻片段的學習都需要極大規(guī)模的高質量數據,而數據的采集、清洗、篩選都是難點。

特斯拉CEO馬斯克在去年的財報會上曾提到數據在自動駕駛方面的重要性:“用100萬個視頻case訓練,勉強夠用;200萬個,稍好一些;300萬個,就會感到Wow(驚嘆);到了1000萬個,就變得難以置信了。”

截至去年,特斯拉已經分析了從特斯拉客戶的汽車中收集的1000萬個視頻片段(clips),他們判斷完成一個端到端自動駕駛的訓練至少需要100萬個、分布多樣、高質量的clips才能正常工作。

要知道,特斯拉在新能源領域的市場占有率非常高,單以國內市場來說,2023年純電動車排名中,特斯拉以市占率19.9%奪冠,而比亞迪位居第二。眼下特斯拉采集的數據量都不夠用,試想其他車企又有多少數據可用?

況且,并不是所有的行車數據都可以用來訓練端到端模型。有自動駕駛工程師就發(fā)現,原本積累的路測數據只有2%可用。如何從海量數據中找出可以用于訓練的有效數據,這又是一道難關。

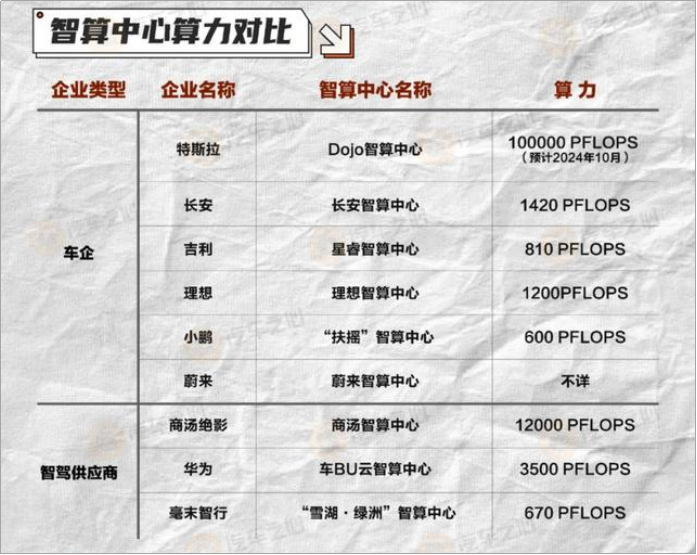

除了采集、篩選這兩道高門檻之外,數據的計算也對玩家們的算力規(guī)模提出了要求,廠商們需要不斷提升GPU的采購規(guī)模,而這也意味著端到端模型的訓練成本非常高昂。

來源:汽車之心

不止于此,端到端技術不得不面對更棘手的問題——黑盒子不可解釋。

前文說到,模塊化技術架構下,決策過程是透明的,決策失誤是可以準確定位的。但端到端技術,從輸入到輸出,這中間的過程卻無法透明化。

試想,如果自動駕駛車輛在緊急情況下做出了錯誤的決策,人們卻無法理解其背后的邏輯,也無法迅速準確定位原因,這意味著要付出極大的安全代價。

路線各有不同

雖然挑戰(zhàn)不少,但在AI智駕趨勢下,端到端大模型還是“上車”,成為了玩家們追逐的新玩法。而站在時間線上,端倒端這一思路最早是由特斯拉提出。

2023年12月,特斯拉的智駕工程師Dhaval Shroff向馬斯克提出建議,拋掉手寫規(guī)則,搭建一張神經網絡,讓它大量觀看人類司機的駕駛視頻,并自行輸出正確的行駛軌跡。

直到今年1月,采用端到端架構的FSD V12正式向北美用戶推送。據介紹,這一版本使用的正是單個端到端的神經網絡,即用一整個囊括輸入到輸出端的大模型,直接進行訓練。

在特斯拉宣布FSD V12將采用端到端大模型之后,國內亦掀起了端到端大模型應用的熱潮,而緊隨特斯拉積極擁抱端到端技術的是華為和小鵬。

但與特斯拉的單個神經網絡不通,華為的ADS 3.0智駕系統(tǒng),是將大模型拆分為感知與認知(預測決策規(guī)劃)兩個階段,串聯(lián)二者做訓練,分別實現感知和規(guī)控的“端到端”。

至于小鵬,則是國內首個發(fā)布量產上車的端到端模型的整車企業(yè)。

今年5月20日,小鵬汽車端到端大模型量產上車;7月30日,端到端加持下的XNGP從“全國都能開”正式升級“全國都好用”,何小鵬在“小鵬汽車AI智駕技術發(fā)布會”上宣布:將向全球用戶全量推送AI天璣系統(tǒng)XOS 5.2.0版本。

不過,在具體的技術路線上,小鵬與華為和特斯拉也有所不同。小鵬的XNGP則分為感知XNet、規(guī)劃XPlaner、控制XBrain三個部分。這一做法等同于將感知、規(guī)劃和控制三個模塊串聯(lián)在一起,用高端的方式統(tǒng)一訓練。

除了以上三家,還有不少玩家也開始選擇端到端。比如今年蔚來單獨設立了一個大模型部,專門負責端到端的模型研發(fā)。

包括理想,在今年5月裁員中也保留了算法研發(fā)團隊:由賈鵬管理,主要負責無圖城市NOA的研發(fā)、落地,以及端到端智駕的預研。

不管選擇什么樣具體途徑,也無論究竟誰在參與,提高駕駛安全性和便捷度永遠都是智駕的核心。雖然眼下端到端模型的比拼愈演愈烈。但對于消費者來說,過程或許不那么重要,結果才是。